阿喵前言

现在各种大模型满天飞,但大家在实际工作中经常会遇到一个非常敏感的痛点:隐私与数据安全。比如你有一堆公司内部的财务报表(Excel)、绝密的产品需求文档(PDF)或者个人日记,你敢直接打包上传给云端的 AI 帮你总结吗?一旦发生数据泄露,后果不堪设想。

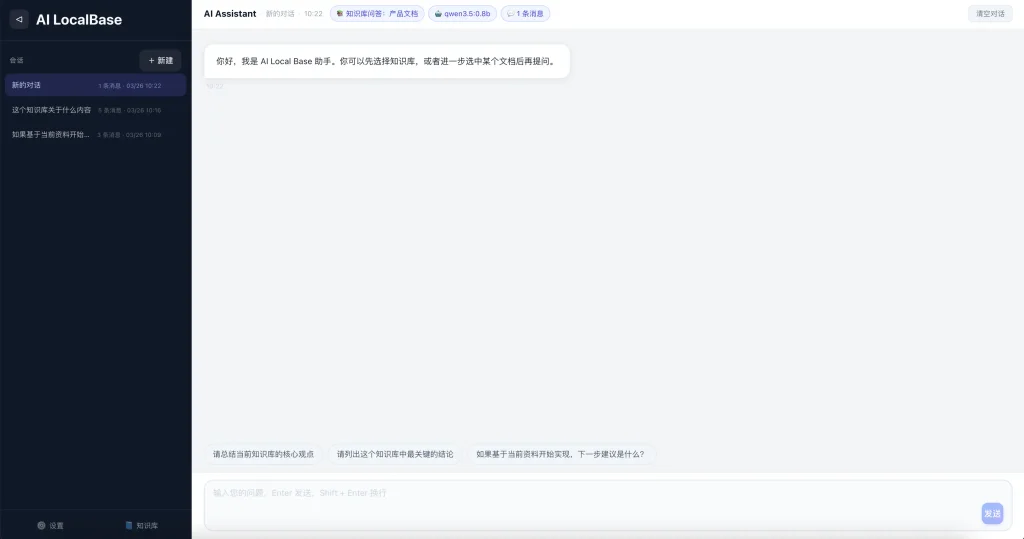

为了解决这个问题,“本地知识库(RAG)”应运而生。今天阿喵给大家推荐一个非常硬核且实用的开源项目——AI-Localbase。它主打“本地优先”,能将你硬盘里的文档安全地接入大模型对话流,而且还前卫地支持了 MCP(Model Context Protocol)服务,绝对是折腾本地 AI 助理的极客必备利器。

项目介绍

AI-Localbase 是一款主打“本地优先(Local-First)”的 AI 知识库系统,基于当下最火热的 RAG(检索增强生成)技术架构打造。

它的核心作用相当于给你的本地大模型(如通过 Ollama 部署的模型)装上了一个“私有外接硬盘”。你可以把本地的各类文档喂给它,它会自动进行向量化处理和存储。当你向 AI 提问时,系统会优先从你的本地私有文档中检索相关内容,再结合大模型生成精准的回答。全程可以做到不依赖外部云端,从根本上杜绝了隐私泄露的风险。

功能特色

作为一款轻量的 RAG 系统,它没有花里胡哨的冗余功能,主打一个稳准狠:

| 功能模块 | 具体表现 | 实用价值 |

| 纯本地隐私保护 | 数据检索与对话流转设计为本地优先环境运行,不依赖外部云存储。 | 敏感数据“不出村”,特别适合财务、法务、开发人员处理机密或私域文档。 |

| 多格式文档解析 | 目前已完美支持 .md、.txt、.pdf(文本提取)、.xlsx、.csv 格式。 | 覆盖了打工人和创作者最常用的文本与表格数据载体,兼容性极佳。 |

| 前沿 MCP 服务接入 | 原生支持 Model Context Protocol(模型上下文协议)。 | 可以作为标准化的数据源,无缝接入到 Claude Desktop、Cursor 等支持 MCP 的顶级 AI 应用中。 |

| 智能辅导搜索 | 将传统的关键词搜索升级为语义级辅导搜索。 | 告别大海捞针,用自然语言向你的本地文档提问,AI 直接为你整理出带有依据的精准答案。 |

使用说明

作为一个开源项目,你需要具备一定的本地开发环境配置能力才能将其跑起来:

1. 基础环境搭建

系统需要依赖大模型进行推理和向量化。你需要在本地准备好大语言模型(如通过 Ollama 运行的 Llama 3 或 Qwen)以及相关的轻量级向量数据库环境(如 Qdrant),以提供底层算力支持。

2. 部署 AI-Localbase

前往项目的 GitHub 仓库,通过 Git 将代码拉取到本地。根据项目主页的文档指引,安装所需的依赖环境,配置好本地模型接口的地址,然后启动服务。

3. 构建与检索

- 投喂数据(索引建立): 在系统中导入你的本地文档(PDF、Markdown、Excel等),AI-Localbase 会自动将其切割并转换为向量数据进行本地存储。

- 开启对话(RAG 问答): 输入你的问题。系统会先去刚才建立的知识库中“翻书”,找到相关片段后,连同问题一起交给大模型处理,输出最终答案。

- MCP 进阶调用: 如果你是高级玩家,可以将其作为 MCP Server 启动,让你的本地开发工具(如 Cursor)直接具备读取你专属知识库的能力。

项目下载

如果你正在寻找一个轻量、注重隐私且支持最新 MCP 协议的本地知识库方案,这个开源项目非常值得折腾一番:

- GitHub 项目主页: https://github.com/veyliss/ai-localbase

- 部署建议: 详细的安装步骤、服务启动命令以及 MCP 的具体接入方法,请前往 GitHub 页面仔细阅读官方的说明文档。