阿喵前言

现在各种开源大模型层出不穷,从 Llama 到 DeepSeek,很多小伙伴都想在自己电脑上本地跑一跑,体验一下私人 AI 的乐趣。但问题来了:我的显存够不够?内存会不会爆?跑起来到底是“对答如流”还是“一秒一个字”?

以前我们得查各种模型参数,算半天显存占用。今天阿喵发现了一个超实用的宝藏网站——CanIRun.ai。它能直接帮你省去这些复杂的计算,行不行,一测便知。

网站介绍

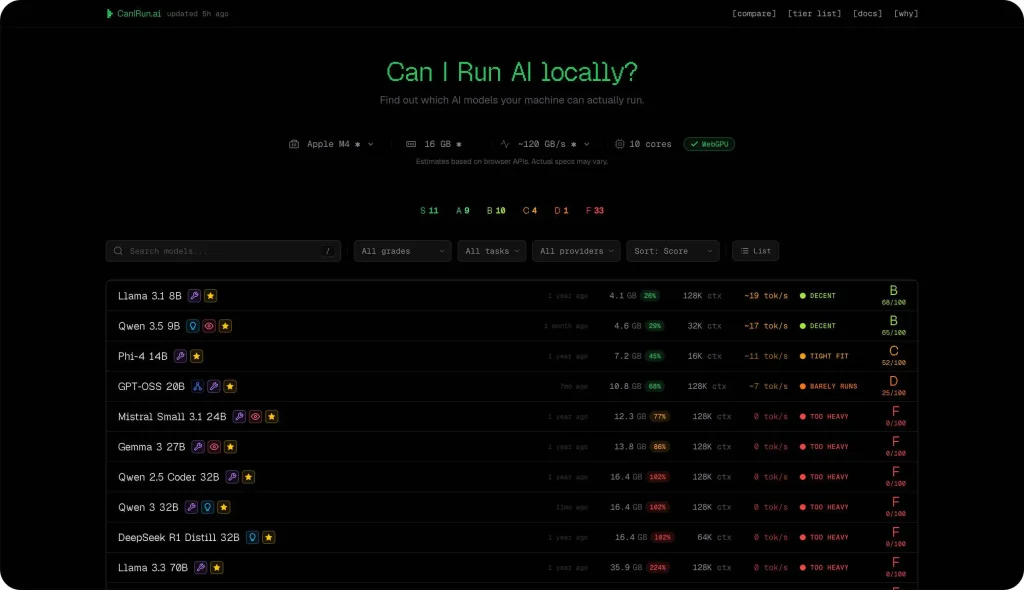

CanIRun.ai 是一个专门为想在本地运行大语言模型(LLM)的用户设计的在线测试工具。它最大的特色是“全自动”,通过浏览器就能读取你的硬件规格,并根据当前主流模型的参数,给出一份详尽的“运行可行性报告”。

截图

特色

- 硬件自动识别:无需手动输入 CPU、GPU 型号或显存大小,网站会自动识别你的系统配置,简单省事。

- 性能实时预估:它不仅告诉你能不能跑,还会预测运行时的每秒 Token 数(TPS)。这能让你直观感受到是“秒回”还是“龟速”。

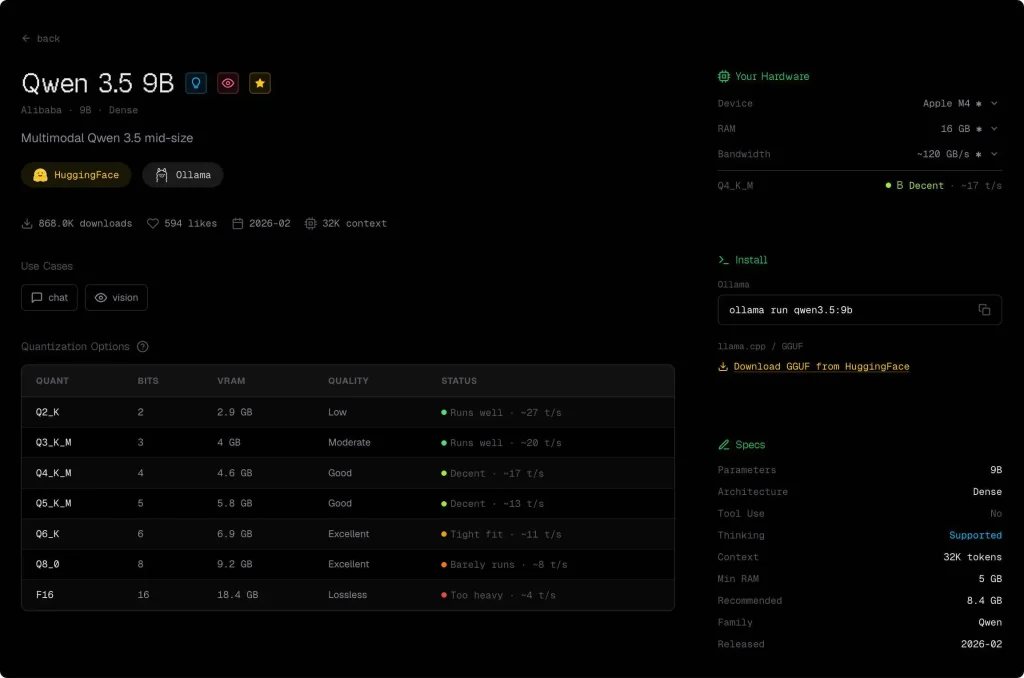

- 量化版本对比:网站会列出不同量化级别(比如 Q4、Q8 等)下的表现,帮你找到性能与效果的最佳平衡点。

- 模型库丰富:涵盖了目前市面上主流的开源模型,无论是写代码的、聊天的还是翻译的,都能在这里找到对应的测试数据。

使用说明

工具的使用非常简单,即便是对硬件不太了解的小伙伴也能轻松搞定:

- 访问网站:打开官网后,给予必要的权限,让网站读取你的硬件信息(通常是基于 WebGPU 技术)。

- 等待扫描:只需几秒钟,你的显卡型号、显存大小、系统内存等关键信息就会显示在页面上方。

- 查看列表:网页下方会自动生成一个清单,绿色表示可以完美运行,黄色表示勉强能跑,红色则表示硬件吃不消。

- 按需筛选:你可以搜索特定的模型名称,看看在你的配置下,哪个版本跑起来最顺滑。

网站地址

阿喵温馨提示:跑大模型对显存的要求比较高,如果测出来速度不理想,可以尝试那些更小参数或者高压缩(量化)的版本。更多关于本地部署 AI 的小技巧需要大家慢慢探索